《2024 年 Elastic 全球威胁报告:可见性增强》

Elastic Security Labs 发现,威胁行为者正在利用现成的被滥用的安全工具和错误配置的环境。

.jpg)

Elastic Security Labs 发布了《2024 年 Elastic 全球威胁报告》,揭示了即将到来的一年中最紧迫的威胁、趋势和建议,以帮助企业确保安全。威胁行为者正在从攻击性安全工具 (OST) 的使用、云环境的错误配置以及对凭据访问的日益重视中获得成功。此报告基于超过 10 亿个数据点的关键遥测数据,重点分析了恶意软件趋势、攻击者战术、云安全和由 Elastic Security Labs 精选的生成式 AI。

“对于像我们这样的云原生公司来说,了解云中的顶级技术非常有价值,”Canva 的检测与响应安全工程总监 Raymond Schippers 说,“但我们从威胁概况中获得了最大的价值。大多数供应商只是发布一个名称,但拥有 Diamond 模型可以帮助我们了解您如何将活动归因于攻击者。《全球威胁报告》提供了一个很好的合理性检查,以确保我们的优先事项与攻击者正在进行的活动保持一致。”

下载《2024 年 Elastic 全球威胁报告》,深入了解威胁形势。

2024 年需要了解的见解

为了方便您阅读,我们在下文中对报告进行了简要概述。如果您想了解更多背景情况,可以在我们的威胁研究页面查看更多要点和文档。

观察到的恶意软件表明,攻击者正在使用现成的工具进行滥用 — 包括生成式 AI

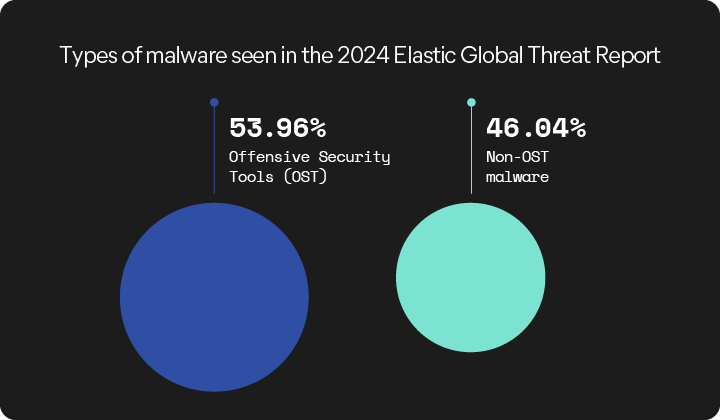

在我们的恶意软件分析中,研究人员发现 Cobalt Strike 和 Metasploit 等 OST 占观察到的警报的约 54%。

威胁行为者滥用这些合法的安全工具,安全团队需要了解恶意使用这些工具的情况。您对 OST 功能了解得越多,对恶意软件的了解就越深。

要更深入地了解攻击者如何滥用 Cobalt Strike,请查看 Elastic 安全实验室对 REF0657 的分类以及为《Elastic Security:揭露金融服务入侵》创建的保护措施。

自首次亮相以来,围绕生成式 AI 的争论一直不绝于耳。在我们发布的防御性 AI 功能套件和我们在 5 月发布的研究中,Elastic 对这种讨论并不陌生。许多组织都陷入恐惧之中,他们询问我们对这项技术的立场。

为什么我们不担心生成式 AI

确实,生成式 AI 会为攻击者提供一些帮助 — 尽管我们的研究人员在过去一年中没有观察到感染率的明显增加,但社交工程攻击的质量有所提高。由于大型语言模型 (LLM) 应用程序的最新进展,防御者还可以预见恶意软件开发的增长。好消息是,这种攻击方式的运行方式与所有恶意软件一样,可以通过及时了解威胁并调整保护库来抵消这种进展。

另一方面,生成式 AI 对防御者的影响最大。总结安全事件集合、自动化复杂分析和管理任务,以及对建议的行动方案进行排序只是这些技术缩短观察与决策之间距离的几个实际例子。

生成式 AI 并没有为威胁行为者带来压倒性优势,我们预计这种情况不会很快改变;但是,安全团队应了解并定期审核其环境 — 尤其是配置和用户错误。

企业错误配置云环境,使威胁行为者得以蓬勃发展

这是一个每个人都熟悉的故事:安全专业人员的工作负担过重。大量的警报、超负荷工作的分析师、试图驾驭复杂环境的团队......不幸的是,这导致了对内置安全控制的过度依赖。我们的遥测结果表明,许多团队在使用云平台时并没有实施额外的必要保护措施。

这些见解是在我们关于云安全态势管理 (CSPM) 的新部分中发现的。我们的研究人员分析了网络安全中心 (CIS) 基准,这些基准是由世界各地的企业共享的,旨在识别云环境中的一些最常见配置错误。这些基准与遥测中看到的环境进行了比较,并且与针对云环境的最常见技术高度重合。

由于《Elastic 全球威胁报告》分析了基于云服务提供商 (CSP) 的云遥测,因此我们能够按 CSP 细分最大的错误配置。读者必须明白,本文并不是在讨论哪个 CSP 最安全,而是关于安全团队如何配置实例的报告。

其中一个最为普遍的问题是存储问题,在 Microsoft Azure 的故障中,有近 47% 与存储账户有关,而在 Amazon Web Services (AWS) 的故障中,有 30% 源于 S3 检查。Google Cloud 用户也未能避免配置错误,其中近 44% 的失败检查都来自 BigQuery — 具体原因是缺乏客户管理的加密。

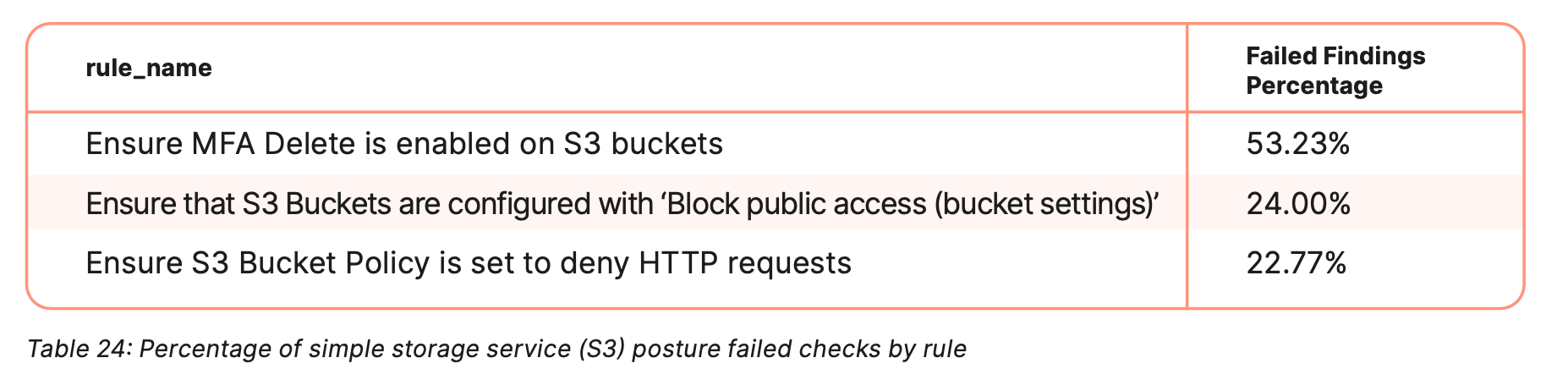

安全团队必须确保云资源得到适当保护并定期接受审计。从 CSPM 部分得到的最大收获之一是,50% 以上的 S3 检查失败是由于多因素身份验证配置错误造成的:

虽然这看起来是一项艰巨的任务,但安全团队必须记住,必须定期调整和审计安全工具。Elastic 的信息安全团队知道这有多么困难,并撰写了一篇博客,详细介绍了他们如何在组织范围内推出防网络钓鱼的 MFA。

在成功抵御“防御规避”之后,攻击者正在利用合法凭据进行渗透

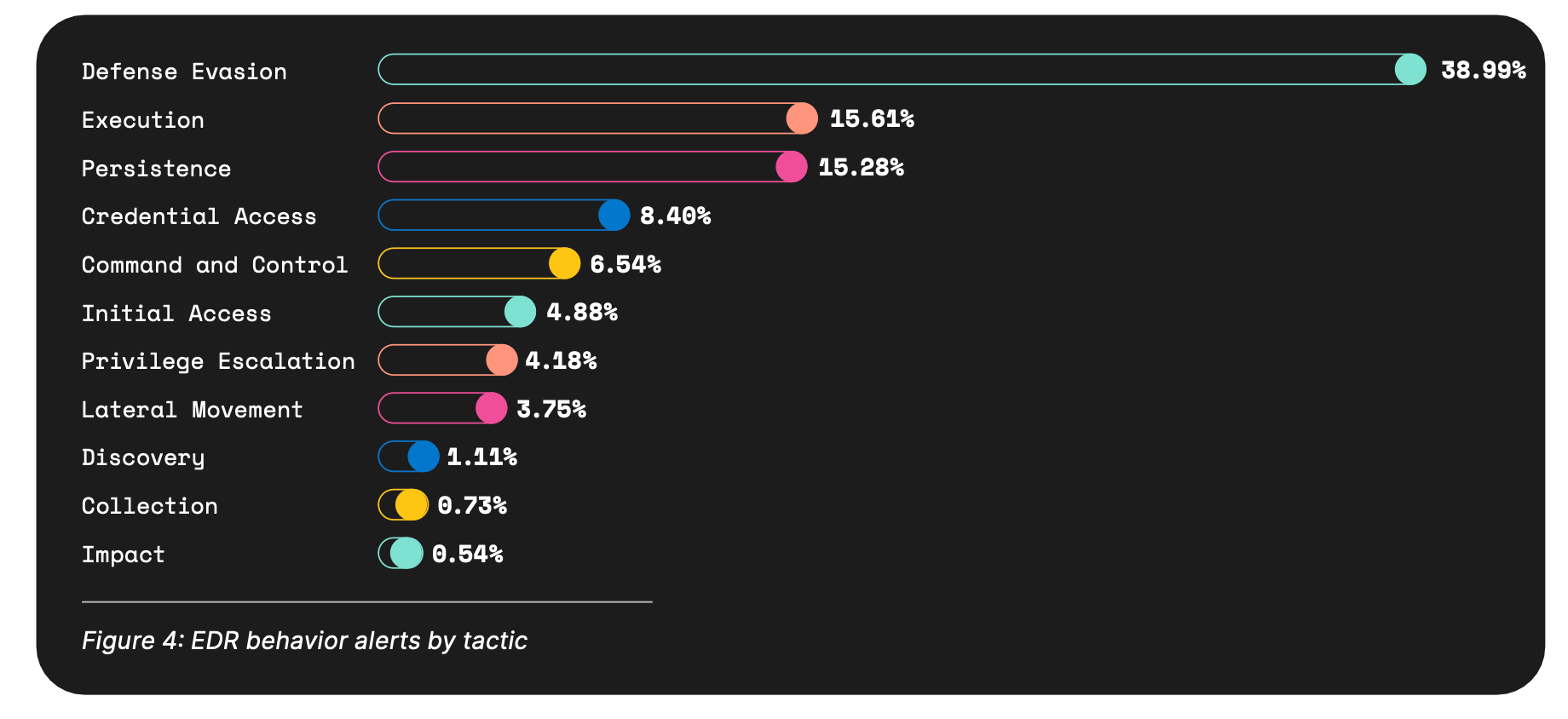

延续多年的趋势并反映安全工具对攻击者的影响,我们观察到大多数行为都与“防御规避”相关。我们在端点和云环境中的遥测数据中都看到了这种趋势,尽管表现方式略有不同。

云中的凭据访问

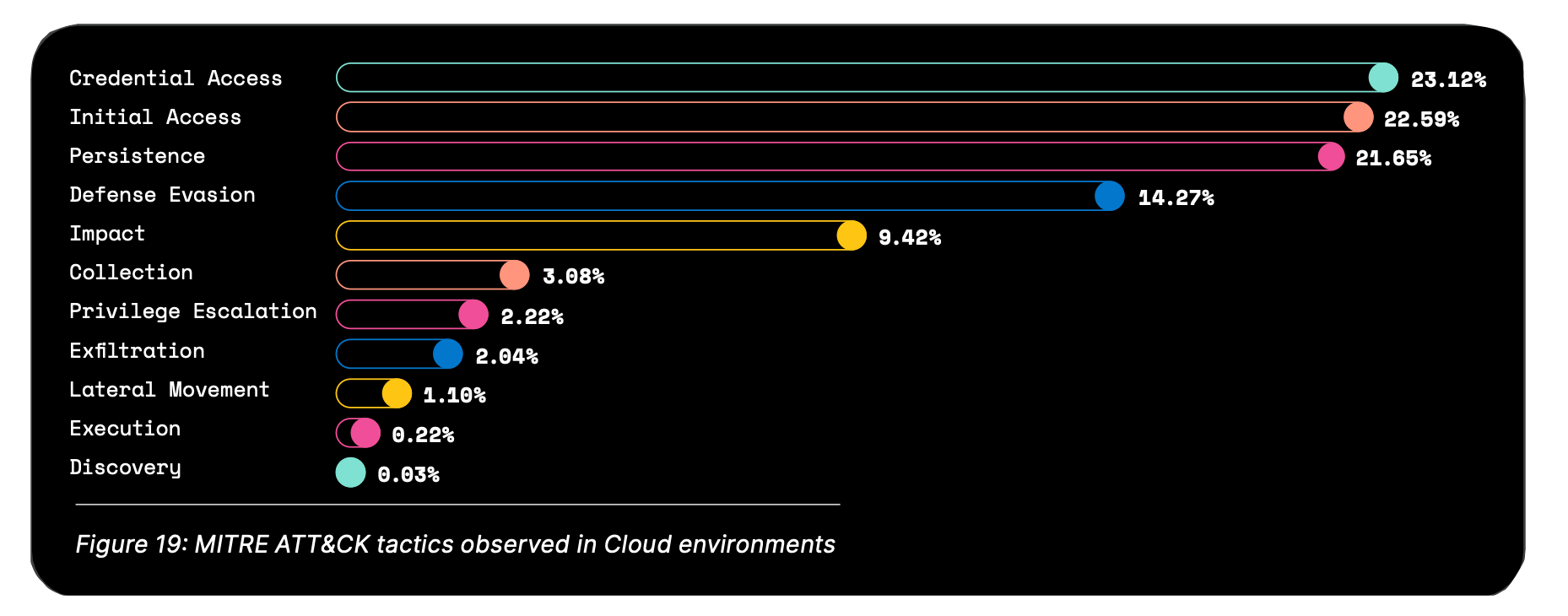

随着云基础架构在技术领域的普及,Elastic Security Labs 大量报告在 CSP 中观察到的行为也就不足为奇了。以下是根据 MITRE ATT&CK 标准,去年在云环境中观察到的主要策略。

凭据访问占所有云行为的 23.12%,主要出现在 Microsoft Azure 环境中。具体而言,Elastic Security Labs 观察到暴力破解技术增加了 12% — 几乎占 Microsoft Azure 所有技术的 35%。

组织必须意识到暴力破解的增加,在我们的报告中,我们多次在不同的环境中看到这种攻击。对于我们监控的终端设备来说,对凭据访问的关注又更进了一步。

终端遥测中的凭据访问

虽然凭据访问在端点行为中所占的比例较小,但我们还是想结合其在云中的普遍性来介绍一下凭据访问。

凭据访问是排名第四的威胁手段,鉴于信息窃取者和访问代理网络的增多,凭据访问值得关注。自去年以来,这一看似微不足道的 3% 增长几乎无法反映威胁行为者利用合法窃取凭据所造成的后果。

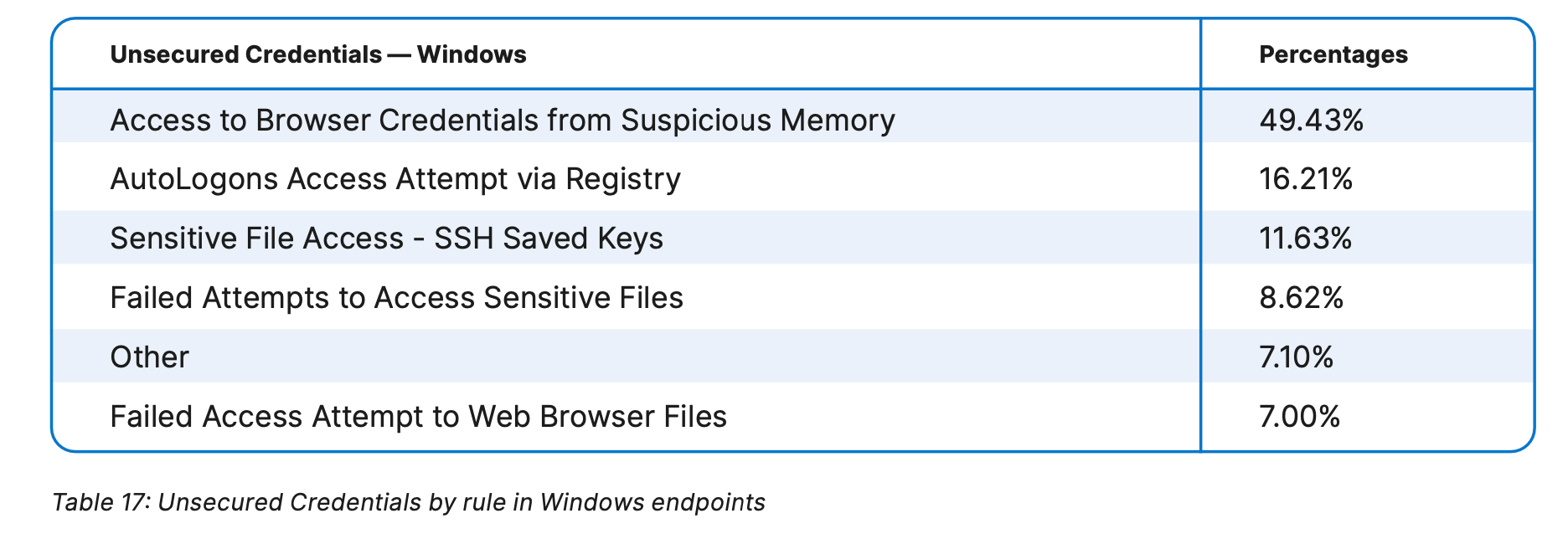

这里的重点是不安全凭据等技术,与去年的分析相比,Windows 端点中的此类技术增加了 31%。在不安全凭据技术中,Elastic 观察到近 50% 涉及从浏览器中窃取凭据。

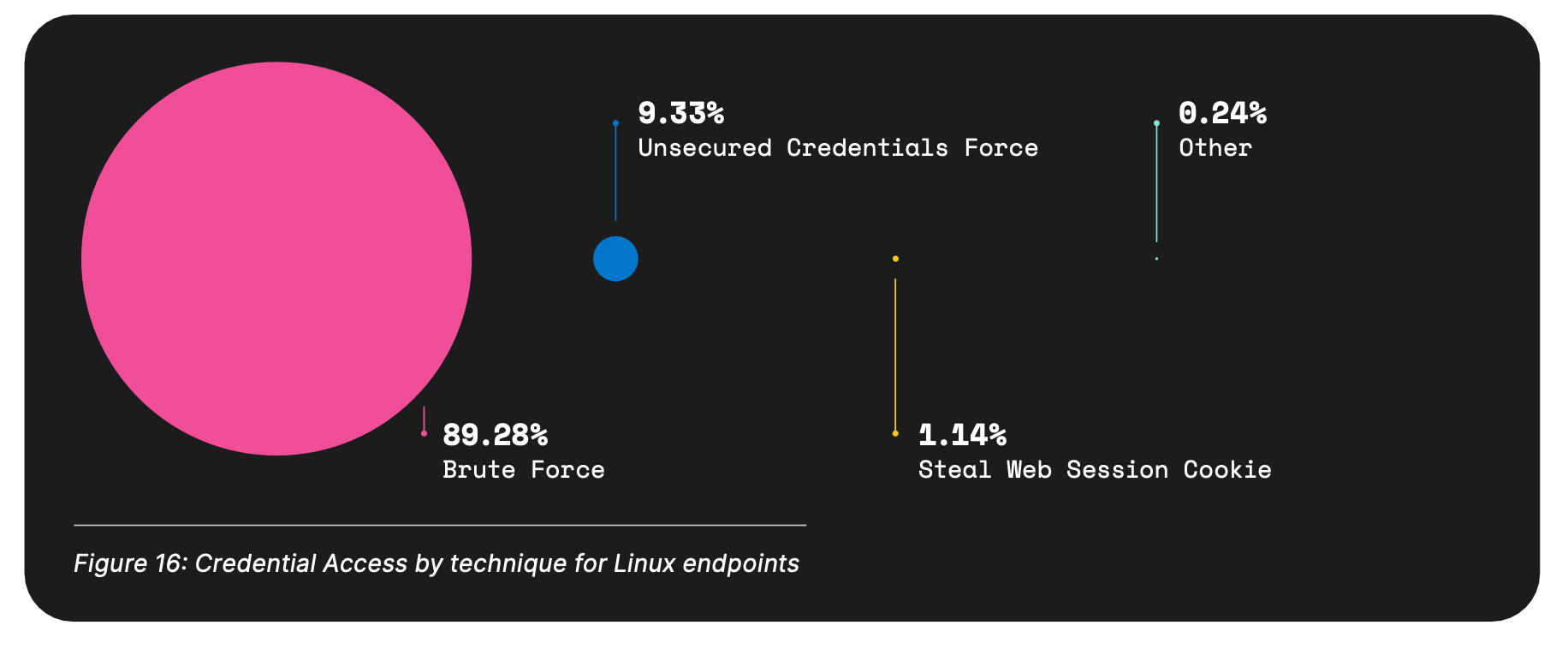

另一个例子是,暴力破解攻击在 Linux 环境中日益流行。虽然终端行为仅占总数的 3.2%,但其中 89% 的行为涉及暴力破解攻击 — 这凸显了 Linux 基础架构的重要性,即使在保持面向公众的同时,也能维护组织关键应用程序。

安全工具中针对防御规避策略的缓解措施已取得成效,去年此类行为减少了 6%。尽管如此,威胁行动者仍将继续使用一切可用的武器进行攻击。

全球概述

《Elastic 全球威胁报告》的发布得益于 Elastic 强大的搜索 AI 平台。我们通过 Elastic 的搜索基础获得了全球视野,从而实现卓越的可见性和惊人的安全威胁检测能力。我们的用户每年与我们共享数亿个事件,这些事件由 Elastic 传感器以及强大的第三方技术生态系统生成。这不仅使 Elastic Security 能够实现定期的功能改进,还使 Elastic Security Labs 能够发现和阻止以前未知的威胁。

这海量的信息为我们这些守护者提供了额外的机会 — 我们可以与整个安全社区的同事共享这些详细信息。我们选择每年都这样做,以便为读者提供可操作的信息。

安全地探索威胁态势

Elastic Security Labs 致力于为情报界提供关键、及时的安全研究 — 无论您是否是 Elastic 的客户。本报告中的发现强化了我们早已知道的事实:防御者技术正在发挥作用。这些发现(以及更多的发现)强调了精心调整的安全产品和策略的重要性。

通过免费的《2024 年 Elastic 全球威胁报告》了解这些见解以及更多信息。

本博文所描述的任何特性或功能的发布及上市时间均由 Elastic 自行决定。当前尚未发布的任何特性或功能可能无法按时提供或根本无法提供。

在本博文中,我们可能使用或提到了第三方生成式 AI 工具,这些工具由其各自所有者拥有和运营。Elastic 对第三方工具没有任何控制权,对其内容、操作或使用不承担任何责任或义务,对您使用此类工具可能造成的任何损失或损害也不承担任何责任或义务。请谨慎使用 AI 工具处理个人、敏感或机密信息。您提交的任何数据都可能用于 AI 训练或其他目的。Elastic 不保证您所提供信息的安全性或保密性。在使用任何生成式 AI 工具之前,您都应自行熟悉其隐私惯例和使用条款。

Elastic、Elasticsearch、ESRE、Elasticsearch Relevance Engine 及相关标志为 Elasticsearch N.V. 在美国和其他国家/地区的商标、徽标或注册商标。所有其他公司和产品名称均为其相应所有者的商标、徽标或注册商标。