Orca nutzt Search AI, um die Nutzer in den Bereichen Transparenz, Compliance und Risikopriorisierung zu unterstützen

Unternehmen stellen immer mehr Anwendungen in der Cloud bereit, daher wird auch die Verwaltung der Cloud-Sicherheitshaltung immer wichtiger. Anbieter von Sicherheitstechnologien wie Orca Security gehen dabei voran und bieten Unternehmen bessere Möglichkeiten, um ihre Umgebungen zu schützen und die größten Cloud-Risiken zu priorisieren. Die Suche nach relevanten Daten gestaltet sich jedoch für Sicherheitsteams oft schwierig, da die Ökosysteme immer komplexer werden und sich die Angreifer immer ausgeklügeltere Methoden ausdenken. Dies gilt insbesondere für Unternehmen, die mit mehreren Cloud-Anbietern arbeiten. Analysten müssen die unterschiedlichen Feinheiten und Merkmale der einzelnen Anbieter kennen, was das Abrufen wichtiger Informationen erschwert.

Selbst bei der Bewertung eines speziell für Vektoreinbettungen entwickelten Datenbankprodukts stellte Orca fest, dass ohne passende Schlüsselwortsuche für Einbettungen nur mangelhafte Ergebnisse zurückgegeben wurden. Darum wendete sich Orca an Elasticsearch, um die erweiterten Suchfunktionen zu integrieren und eine intelligente, KI-gestützte Suchmaschine für die Sicherheitslösung des Unternehmens zu erstellen. Mit dieser strategischen Entscheidung konnte Orca die Plattform des Unternehmens transformieren und den Nutzern komplexe, domänenspezifische Suchabfragen ohne Aufwand und mit großer Genauigkeit anbieten.

Die Suche im Rampenlicht

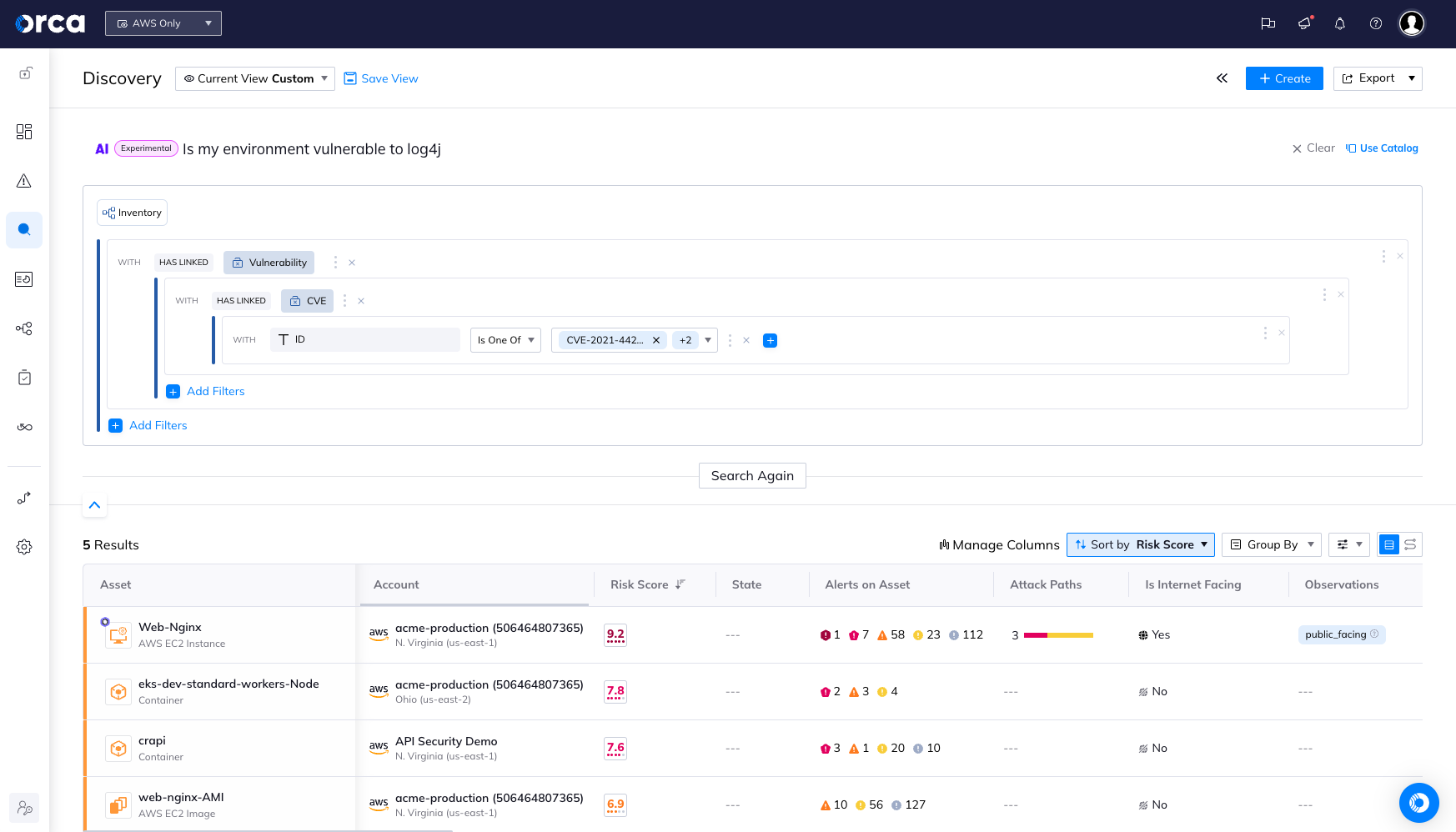

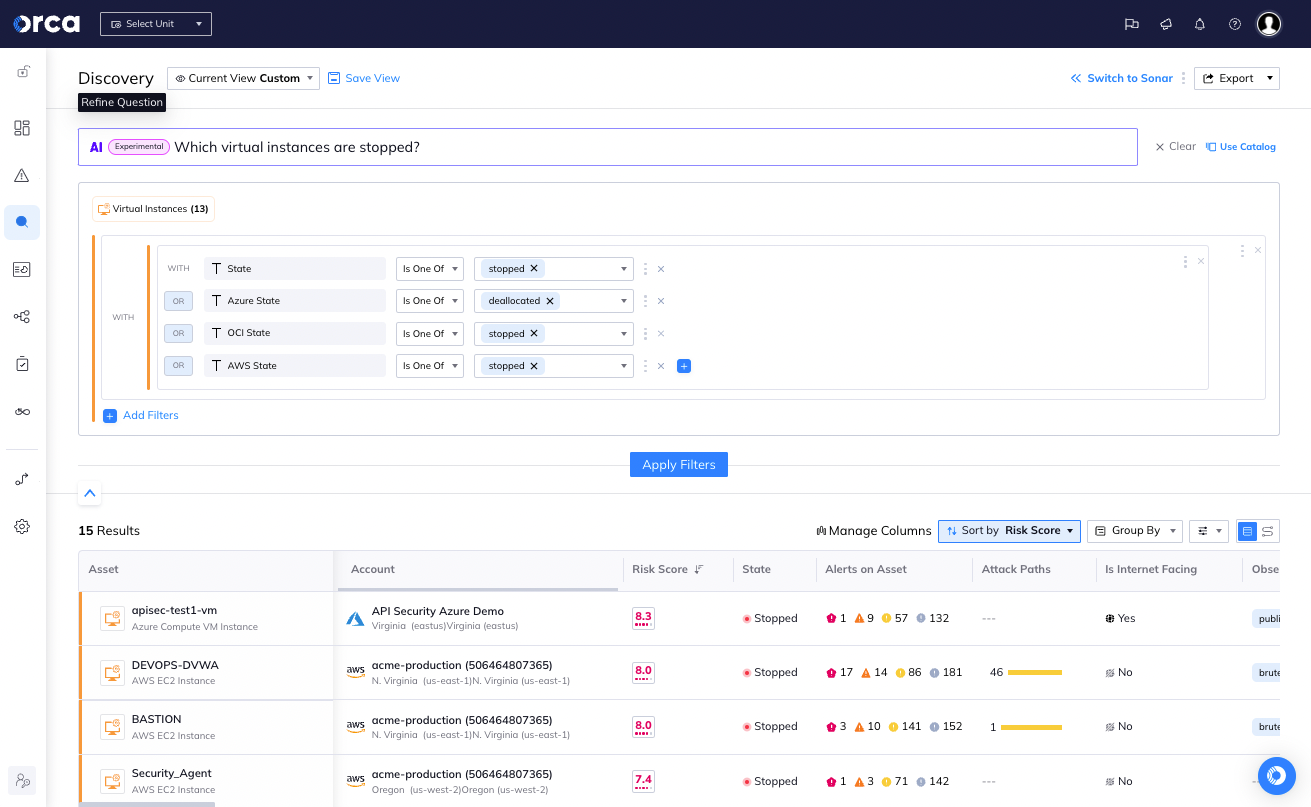

Orca Security brauchte ein Tool, um sich seinen Vorsprung zu erhalten und mit den Anforderungen von Cybersicherheitsteams (sowie Entwicklungs-, DevOps-, Cloudarchitektur-, Risiko-Governance- und Compliance-Teams) mitzuhalten, die jederzeit mühelos und intuitiv genau erfahren müssen, was in ihren Cloud-Umgebungen vor sich geht. Teams im gesamten Unternehmen sollten unabhängig von ihrer Kenntnisstufe schnell auf Zero-Day-Risiken reagieren, Audits durchführen, Cloud-Assets optimieren und die Gefahr von Bedrohungen erkennen können, um datengestützte Entscheidungen zu erleichtern.

Orca stellte fest, dass die Nutzer dafür eine intelligente und intuitive In-App-Möglichkeit brauchten, um domänenspezifische Abfragen zu stellen, komplexe Fragen einfach zu formulieren und sofort exakte Ergebnisse zu erhalten. Ein mögliches Beispiel sind Kundenfragen wie etwa „Welche aus dem Internet verfügbaren VMs enthalten personenbezogene Gesundheitsdaten“? Diese Abfragen erfordern ein Verständnis komplexer Themen, Attribute und Beziehungen in den Daten. Orca brauchte eine Suchmaschine, die solche Fragen interpretieren und automatisch die passenden Filter generieren kann.

Darum bemühte sich das Team von Orca, eine KI-gestützte Suchmaschine zu implementieren, um diese komplexen Aufgaben zu vereinfachen, und Elasticsearch war perfekt geeignet. Elasticsearch bietet zahlreiche Vorteile für die allgemeinen Ziele der KI-gestützten Suchmaschine von Orca Security. Hier sind einige der wichtigsten Vorteile von Elasticsearch für das Orca-Team:

Leistungsstarke Suchfunktionen

Elasticsearch bietet eine Hybrid-Suchkonfiguration mit einer Kombination aus Schlüsselwortabgleich und Vektorsuche und liefert präzise und relevante Ergebnisse selbst für komplexe Abfragen mit domänenspezifischen Begriffen und Attributen. Die leistungsstarken Filterfunktionen sind unverzichtbar, insbesondere beim Umgang mit Schemas wie dem Orca Schema. Wenn das Thema der Abfrage beispielsweise als „VM“ erkannt wird und die KI nach einem Attribut wie „enthält personenbezogene Daten“ sucht, kann Elasticsearch den Bereich der Suche einschränken und nur VM-bezogene Attribute herausfiltern. Damit werden irrelevante Attribute aus anderen Modellen ausgeschlossen, wie etwa personenbezogene Daten in Datenbanken, um die Genauigkeit zu verbessern und sicherzustellen, dass nur gültige Abfragen erstellt werden.

Flexibilität und Anpassbarkeit

Die Elasticsearch-Unterstützung für nutzerdefinierte Boostings und Felder mit Mehrfachabgleich verbessert die Suchqualität. Durch ein unterschiedliches Gewichtungs-Boosting von Namen und Beschreibungen lassen sich beispielsweise ausgewogene Suchergebnisse erzielen. Orca nutzt diese Features für die Feinjustierung von Suchparametern und um den Nutzern ein maßgeschneidertes Erlebnis zu bieten.

Kosten- und Leistungseffizienz

Elasticsearch ermöglicht beträchtliche Kosteneinsparungen für Anwendungsfälle mit generativer KI, indem die Last für herkömmliche große Sprachmodelle (Large Language Models, LLMs) reduziert wird. Diese Modelle sind oft aufwändig und langsam, insbesondere beim Verarbeiten großer Datenvolumen. Die Filter- und Abruffunktionen von Elasticsearch ermöglichen eine schnelle und kosteneffektive Suche. Durch die Optimierung der Auswahl relevanter Beispiele für alle Abfragen, auch bekannt als Retrieval Augmented Generation (RAG), kann Elasticsearch die Betriebskosten für LLMs beträchtlich reduzieren.

Mit generischen Daten trainierte Foundation-LLMs sind oft nicht in der Lage, die Orca-Abfragesprache (DSL) oder den extrem dynamischen Cybersicherheits-Datengraphen mit Tausenden von einzigartigen Asset-Typen und Attributen zu verstehen. Allein für das Erklären der DSL-Regeln wurden etwa 2.000 Token verbraucht, und die Bereitstellung von Transformationsbeispielen hat diesen Wert noch weiter erhöht. Angesichts der eingeschränkten Kontextfenster von LLMs (8.000 Token auf einmal) führt jedes weitere Token zu mehr Latenz und höheren Kosten. Mit Elasticsearch konnten wir die 3 bis 6 relevantesten Beispiele aus Hunderten auswählen und sicherstellen, dass wirklich nur erforderliche Daten an das LLM übermittelt werden. Auf diese Weise konnten wir nicht nur Kosten sparen, sondern auch Genauigkeit und Latenz optimieren.

LLM-Auslastung

Genaue Zahlen bleiben unser Betriebsgeheimnis, aber unter dem Strich ist das Fazit eindeutig: Mit Elasticsearch konnten wir die Menge der an das LLM übermittelten Daten drastisch reduzieren. Durch die Vorfilterung und Kuratierung der relevantesten Beispiele (3 bis 6 aus potenziell Hunderten) haben wir die LLM-Arbeitsauslastung minimiert. Dies hat sich direkt in schnelleren Reaktionszeiten, niedrigeren Kosten und einem effizienteren allgemeinen Sucherlebnis gezeigt.

Die KI-Suche ist eines der beliebtesten Features der Plattform, und die Nutzer haben Abfragen mit Tausenden und Abertausenden verschiedener Cybersicherheitskonzepte und -permutationen in Dutzenden von Sprachen ausgeführt (mehr zur Sprachunterstützung in einem späteren Beitrag).

Search AI als Turbo für das Cloud-Sicherheitserlebnis

Mit der Power von Elasticsearch und dem umfassenden Engagement für KI-Innovation konnte das Orca-Team die User Journey deutlich verbessern. Das neue Sucherlebnis erfordert weniger Vorkenntnisse, vereinfacht Aufgaben, beschleunigt die Fehlerbehebung und verbessert das Verständnis der Cloud-Umgebung. So funktioniert dieser Prozess:

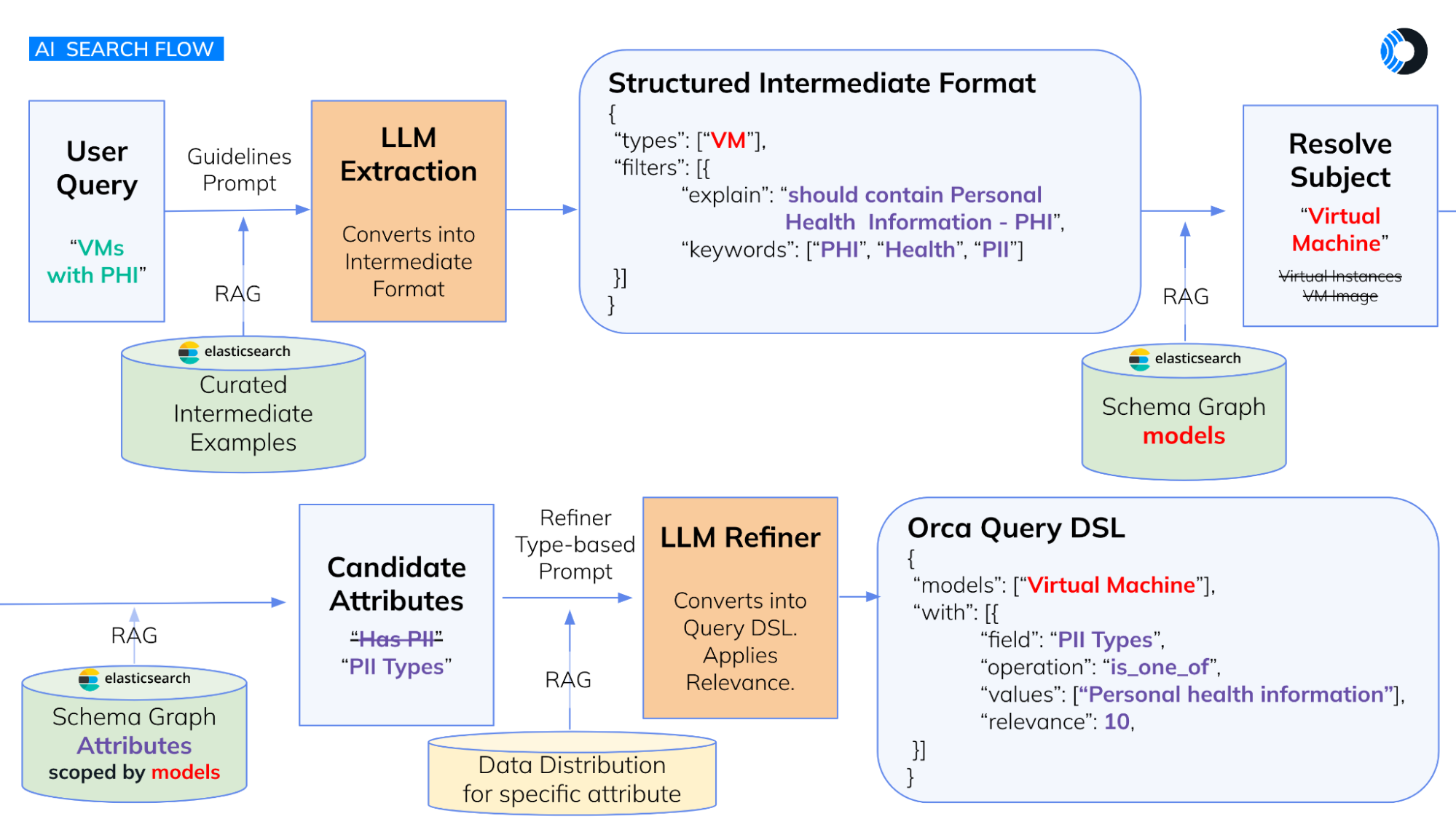

Schritt 1: Verarbeitung von Nutzerabfragen

Die Untersuchung beginnt damit, dass ein Nutzer eine Abfrage in ein Suchfeld eingibt. Orca Security verwendet ein LLM, um die Frage des Nutzers in ein Zwischenformat umzuwandeln. Dieses Format enthält das Thema der Abfrage (z. B. virtueller Computer) und die benötigten Attribute (z. B. personenbezogene Gesundheitsdaten).

Schritt 2: Datentransformation und RAG

Im Fall von Orca werden mit RAG Beispiele kuratiert, um die Nutzerabfragen in ein Zwischenformat umzuwandeln. Wenn jemand eine Abfrage eingibt, wählt Elasticsearch die relevantesten Beispiele mit einer Kombination von Schlüsselwortabgleich und Einbettungssuche aus.

Für die Abfrage „Assets mit personenbezogenen Daten“ findet Elasticsearch die relevantesten kuratierten Beispiele, wie etwa:

„Haben wir personenbezogene Daten außerhalb von Europa?“

„VMs mit Kreditkartendaten und PCI, die unverschlüsselte SSH-Schlüssel verwenden“

„Nicht mehr genutzte Assets und Ressourcen“

Jedes Beispiel enthält eine eigene kuratierte erwartete JSON-Ausgabe und eine Begründung. Auf diese Weise erhält das LLM genügend Kontext, um die Abfrage zielsicher in ein strukturiertes Format zu transformieren, was wiederum das allgemeine Sucherlebnis verbessert und die Erstellung gültiger Abfragen garantiert.

In Schritt 2 ist die Verwendung von RAG mit Elasticsearch entscheidend für das Übersetzen der Nutzerabfragen in die interne Orca-Darstellung. So funktioniert dieser Prozess:

Kuratierte Beispiele: Wir haben Hunderte von Beispielen erstellt, um zu zeigen, wie Abfragen in natürlicher Sprache in das strukturierte Orca-Format transformiert werden.

Die Rolle von Elasticsearch: Für jede neue Nutzerabfrage identifiziert Elasticsearch die relevantesten Beispiele aus unseren kuratierten Daten. Dazu wird eine Kombination von Schlüsselwortabgleich (Suche nach exakten Begriffen) und Einbettungssuche (Verständnis semantischer Ähnlichkeit) verwendet.

Beispiel: Für die Nutzerabfrage „Zeige mir alle aus dem Internet erreichbaren Server mit Sicherheitslücken“ liefert Elasticsearch Beispiele wie etwa „Finde alle aus dem Internet erreichbaren Assets“, „Liste alle Server mit kritischen CVEs auf“ und „Zeige mir Ressourcen mit fehlenden Sicherheits-Patches“.

Die Aufgabe des LLM: Diese relevanten Beispiele werden zusammen mit der ursprünglichen Nutzerabfrage an das LLM übermittelt. Anschließend kann das LLM mit diesem Kontext die Nutzerabfrage exakt in die strukturierte Orca-Abfragesprache umwandeln.

Wir haben auch ein speziell für Vektoreinbettungen entwickeltes Datenbankprodukt ausgewertet, mussten aber feststellen, dass ohne passende Schlüsselwortsuche für Einbettungen nur mangelhafte Ergebnisse zurückgegeben wurden.

Schritt 3: Schemamodellierung und Attributabgleich

Orca Security hat das gesamte Schema in Elasticsearch modelliert, inklusive Hunderter Themen und Tausender Attribute. Die exakten Abgleichfunktionen von Elasticsearch übersetzen Nutzerabfragen in die entsprechenden Begriffe aus der Orca-Datenbank. Wenn sich eine Abfrage beispielsweise auf eine „VM“ bezieht, muss das System auch verschiedene verwandte Begriffe wie „virtueller Computer“ oder „virtuelle Maschine“ verstehen.

Schritt 4: Mehr Relevanz durch Schlüsselwörter

Um die Relevanz der Suchergebnisse zu verbessern, generiert das LLM Schlüsselwörter aus der Nutzerabfrage. Diese Schlüsselwörter verbessern die Relevanz der Suchattribute und garantieren, dass das System die relevantesten Daten zurückgibt. Außerdem übersetzt das LLM die Abfrage in die domänenspezifische Sprache von Orca Security, um sie im Front-End ausführen zu können.

Wie geht es weiter für Orca und KI?

Die Vision von Orca Security umfasst mehr als nur bessere Suchfunktionen und zielt darauf ab, erweiterte Datenanalysen für alle Nutzer bereitzustellen, unabhängig von deren technischem Fachwissen. Durch die Nutzung von Elasticsearch und KI wird Orca Security die Art und Weise transformieren, wie Nutzer mit Daten interagieren und diese auswerten. Mit dieser Integration hat Orca Security nicht nur das eigene Dienstangebot erweitert, sondern auch neue Maßstäbe für KI-gestützte Suchfunktionen in der Cybersicherheitsbranche gesetzt. Die Zukunft ist vielversprechend, und Orca Security wird auch weiterhin neue Wege mit KI und Elasticsearch beschreiten.

Mehr über Elastic und Orca Security:

- Auf der Website von Orca Security erfahren Sie mehr über das Angebot des Unternehmens.

- Lesen Sie mehr darüber, woran wir derzeit in den Elastic Search Labs arbeiten.

- Entdecken Sie weitere innovative Anwendungsfälle für KI-Sucherlebnisse mit Elastic.

Die Entscheidung über die Veröffentlichung von Features oder Leistungsmerkmalen, die in diesem Blogeintrag beschrieben werden, oder über den Zeitpunkt ihrer Veröffentlichung liegt allein bei Elastic. Es ist möglich, dass nicht bereits verfügbare Features oder Leistungsmerkmale nicht rechtzeitig oder überhaupt nicht veröffentlicht werden.

In diesem Blogeintrag haben wir möglicherweise generative KI-Tools von Drittanbietern verwendet oder darauf Bezug genommen, die von ihren jeweiligen Eigentümern betrieben werden. Elastic hat keine Kontrolle über die Drittanbieter-Tools und übernimmt keine Verantwortung oder Haftung für ihre Inhalte, ihren Betrieb oder ihre Anwendung sowie für etwaige Verluste oder Schäden, die sich aus Ihrer Anwendung solcher Tools ergeben. Gehen Sie vorsichtig vor, wenn Sie KI-Tools mit persönlichen, sensiblen oder vertraulichen Daten verwenden. Alle Daten, die Sie eingeben, können für das Training von KI oder andere Zwecke verwendet werden. Es gibt keine Garantie dafür, dass Informationen, die Sie bereitstellen, sicher oder vertraulich behandelt werden. Setzen Sie sich vor Gebrauch mit den Datenschutzpraktiken und den Nutzungsbedingungen generativer KI-Tools auseinander.

Elastic, Elasticsearch, ESRE, Elasticsearch Relevance Engine und zugehörige Marken, Waren- und Dienstleistungszeichen sind Marken oder eingetragene Marken von Elastic N.V. in den USA und anderen Ländern. Alle weiteren Marken- oder Warenzeichen sind eingetragene Marken oder eingetragene Warenzeichen der jeweiligen Eigentümer.